ল্যাংচেইন হল ওপেনএআই পরিবেশ ব্যবহার করে ডেটাসেট বা ইন্টারনেট থেকে তথ্য পেতে চ্যাট মডেল এবং এলএলএম তৈরির কাঠামো। স্ট্রাকচার্ড আউটপুট পার্সারটি প্রকৃত উত্তর এবং কিছু অতিরিক্ত সম্পর্কিত তথ্যের মতো একাধিক ক্ষেত্র বা প্রতিক্রিয়া পেতে ব্যবহৃত হয়। আউটপুট পার্সার লাইব্রেরিগুলি LLM বা চ্যাট মডেল হিসাবে নির্মিত মডেলগুলি ব্যবহার করে ডেটা বের করতে LangChain এর সাথে ব্যবহার করা যেতে পারে।

এই পোস্টটি LangChain-এ কাঠামোগত আউটপুট পার্সার ব্যবহার করার প্রক্রিয়া প্রদর্শন করেছে।

ল্যাংচেইনে স্ট্রাকচার্ড আউটপুট পার্সার কীভাবে ব্যবহার করবেন?

LangChain-এ স্ট্রাকচার্ড আউটপুট পার্সার ব্যবহার করতে, কেবল এই পদক্ষেপগুলি দিয়ে যান:

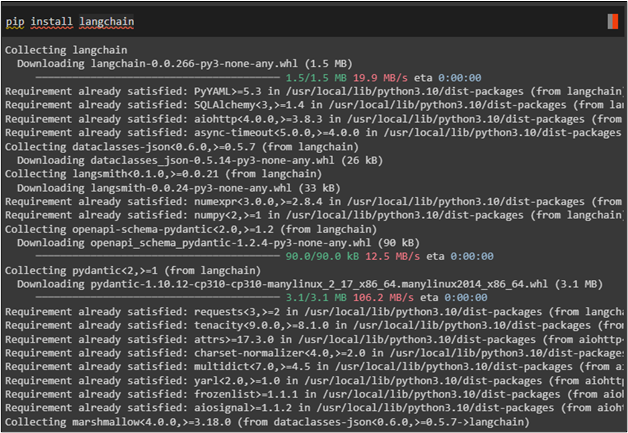

ধাপ 1: পূর্বশর্ত ইনস্টল করুন

ল্যাংচেইন ফ্রেমওয়ার্ক ইনস্টল করে প্রক্রিয়াটি শুরু করুন যদি এটি ইতিমধ্যে আপনার পাইথন পরিবেশে ইনস্টল না থাকে:

পিপ ইনস্টল ল্যাংচেইন

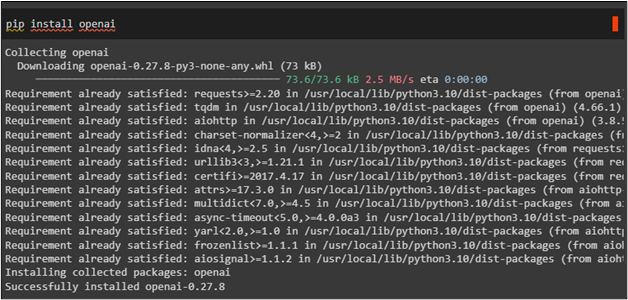

LangChain-এ একটি পার্সার তৈরি করতে এর পদ্ধতিগুলি অ্যাক্সেস করতে OpenAI ফ্রেমওয়ার্ক ইনস্টল করুন:

পিপ ইনস্টল openai

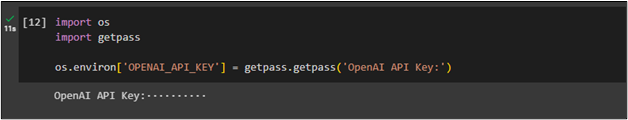

এর পরে, কেবলমাত্র ওপেনএআই এনভায়রনমেন্টের সাথে সংযোগ করুন এর এপিআই কী ব্যবহার করে এর পরিবেশ অ্যাক্সেস করতে “ আপনি ' লাইব্রেরি এবং ' ব্যবহার করে API কী প্রদান করুন গেটপাস লাইব্রেরী:

আমাদের আমদানি করুনগেটপাস আমদানি করুন

os.environ [ 'OPENAI_API_KEY' ] = getpass.getpass ( 'ওপেনএআই এপিআই কী:' )

ধাপ 2: আউটপুট/প্রতিক্রিয়ার জন্য স্কিমা তৈরি করুন

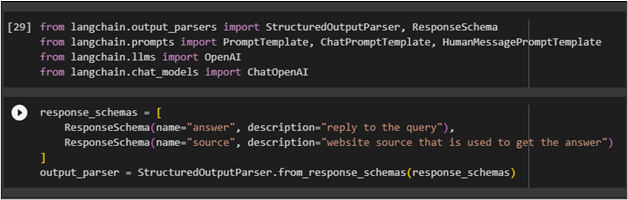

OpenAI এর সাথে সংযোগ পাওয়ার পরে, আউটপুট তৈরি করার জন্য স্কিমা তৈরি করতে কেবল লাইব্রেরিগুলি আমদানি করুন:

langchain.output_parsers থেকে StructuredOutputParser, ResponseSchema আমদানি করুনlangchain.prompts থেকে প্রম্পট টেমপ্লেট, ChatPromptTemplate, HumanMessagePromptTemplate আমদানি করুন

langchain.llms আমদানি OpenAI থেকে

langchain.chat_models থেকে ChatOpenAI আমদানি করুন

প্রয়োজন অনুযায়ী প্রতিক্রিয়ার জন্য স্কিমা নির্দিষ্ট করুন যাতে মডেলটি সেই অনুযায়ী প্রতিক্রিয়া তৈরি করে:

প্রতিক্রিয়া_স্কিম = [রেসপন্স স্কিমা ( নাম = 'উত্তর' , বর্ণনা = 'প্রশ্নের উত্তর' ) ,

রেসপন্স স্কিমা ( নাম = 'উৎস' , বর্ণনা = 'ওয়েবসাইট উৎস যা উত্তর পেতে ব্যবহৃত হয়' )

]

output_parser = StructuredOutputParser.from_response_schemas ( প্রতিক্রিয়া_স্কিম )

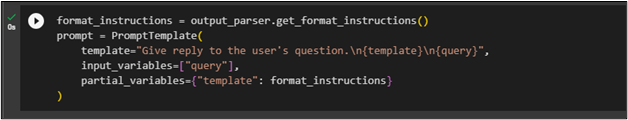

ধাপ 3: ফর্ম্যাট টেমপ্লেট

আউটপুটের জন্য স্কিমা কনফিগার করার পরে, স্বাভাবিক ভাষায় ইনপুটের জন্য টেমপ্লেটটি সেট করুন যাতে মডেলটি এর জন্য উত্তর আনার আগে প্রশ্নগুলি বুঝতে পারে:

format_instructions = output_parser.get_format_instructions ( )prompt = প্রম্পট টেমপ্লেট (

টেমপ্লেট = 'ব্যবহারকারীর প্রশ্নের উত্তর দিন। \n {টেমপ্লেট} \n {প্রশ্ন}' ,

input_variables = [ 'প্রশ্ন' ] ,

আংশিক_ভেরিয়েবল = { 'টেমপ্লেট' : বিন্যাস_নির্দেশ }

)

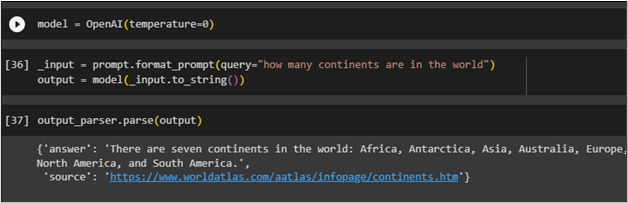

পদ্ধতি 1: ভাষা মডেল ব্যবহার করা

প্রশ্ন ও উত্তরের জন্য ফরম্যাট টেমপ্লেট কনফিগার করার পর, OpenAI() ফাংশন ব্যবহার করে মডেলটি তৈরি করুন:

মডেল = OpenAI ( তাপমাত্রা = 0 )

'এ প্রম্পট সেট করুন' প্রশ্ন ” পরিবর্তনশীল এবং এটি পাস বিন্যাস_প্রম্পট() ইনপুট হিসাবে কাজ করুন এবং তারপর উত্তরটি 'এ সঞ্চয় করুন আউটপুট পরিবর্তনশীল:

_input = prompt.format_prompt ( প্রশ্ন = 'পৃথিবীতে কয়টি মহাদেশ আছে' )আউটপুট = মডেল ( _input.to_string ( ) )

কল পার্স () মডেল থেকে উত্তর পেতে তার যুক্তি হিসাবে আউটপুট ভেরিয়েবলের সাথে ফাংশন:

output_parser.parse ( আউটপুট )

আউটপুট পার্সার প্রশ্নের উত্তর পায় এবং ওয়েবসাইটের পৃষ্ঠার লিঙ্ক সহ একটি বিস্তারিত উত্তর প্রদর্শন করে যা উত্তর পেতে ব্যবহৃত হয়:

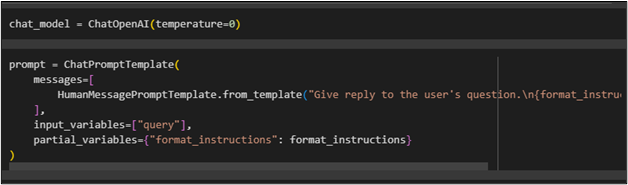

পদ্ধতি 2: চ্যাট মডেল ব্যবহার করা

LangChain এ আউটপুট পার্সার থেকে ফলাফল পেতে, ব্যবহার করুন চ্যাট_মডেল নীচের পরিবর্তনশীল:

chat_model = ChatOpenAI ( তাপমাত্রা = 0 )

প্রম্পট বুঝতে, চ্যাট মডেলের জন্য প্রম্পট টেমপ্লেট কনফিগার করুন। তারপর, ইনপুট অনুযায়ী প্রতিক্রিয়া তৈরি করুন:

প্রম্পট = ChatPromptTemplate (বার্তা = [

HumanMessagePromptTemplate.from_template ( 'ব্যবহারকারীর প্রশ্নের উত্তর দিন। \n {format_instructions} \n {প্রশ্ন}' )

] ,

input_variables = [ 'প্রশ্ন' ] ,

আংশিক_ভেরিয়েবল = { 'বিন্যাস_নির্দেশ' : বিন্যাস_নির্দেশ }

)

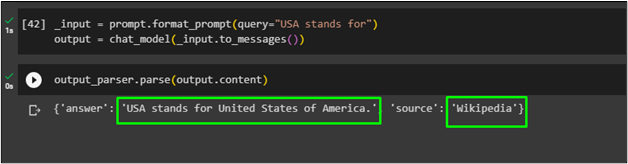

এর পরে, কেবল 'এ ইনপুট প্রদান করুন প্রশ্ন ” পরিবর্তনশীল এবং তারপর এটি পাস চ্যাট_মডেল() মডেল থেকে আউটপুট পেতে ফাংশন:

_input = prompt.format_prompt ( প্রশ্ন = 'USA মানে' )আউটপুট = চ্যাট_মডেল ( _input.to_messages ( ) )

চ্যাট মডেল থেকে প্রতিক্রিয়া পেতে, output_parser ব্যবহার করুন যা “থেকে ফলাফল সংরক্ষণ করে আউটপুট পরিবর্তনশীল:

output_parser.parse ( output.content )

চ্যাট মডেলটি প্রশ্নের উত্তর এবং ইন্টারনেট থেকে উত্তর পেতে ব্যবহৃত ওয়েবসাইটের নাম প্রদর্শন করেছে:

এটি ল্যাংচেইনে একটি কাঠামোগত আউটপুট পার্সার ব্যবহার করার বিষয়ে।

উপসংহার

LangChain-এ স্ট্রাকচার্ড আউটপুট পার্সার ব্যবহার করতে, প্রক্রিয়াটি শুরু করতে LangChain এবং OpenAI মডিউলগুলি ইনস্টল করুন। এর পরে, এর API কী ব্যবহার করে OpenAI পরিবেশের সাথে সংযোগ করুন এবং তারপর মডেলের জন্য প্রম্পট এবং প্রতিক্রিয়া টেমপ্লেটগুলি কনফিগার করুন। আউটপুট পার্সার ভাষা মডেল বা চ্যাট মডেলের সাথে ব্যবহার করা যেতে পারে। এই নির্দেশিকা উভয় পদ্ধতির সাথে আউটপুট পার্সার ব্যবহার ব্যাখ্যা করে।