বাক্য গঠন:

Hugging Face প্রদান করে এমন বিভিন্ন পরিষেবা রয়েছে কিন্তু এর বহুল ব্যবহৃত একটি পরিষেবা হল 'API'৷ এপিআই বিভিন্ন অ্যাপ্লিকেশনে প্রাক-প্রশিক্ষিত এআই এবং বড় ভাষা মডেলের মিথস্ক্রিয়াকে অনুমতি দেয়। আলিঙ্গন মুখ নিচের তালিকাভুক্ত বিভিন্ন মডেলের জন্য API প্রদান করে:

- পাঠ্য প্রজন্মের মডেল

- অনুবাদ মডেল

- অনুভূতি বিশ্লেষণের জন্য মডেল

- ভার্চুয়াল এজেন্টের বিকাশের মডেল (বুদ্ধিমান চ্যাটবট)

- শ্রেণিবিন্যাস এবং রিগ্রেশন মডেল

আসুন এখন আলিঙ্গন মুখ থেকে আমাদের ব্যক্তিগতকৃত অনুমান API পাওয়ার পদ্ধতি আবিষ্কার করি। এটি করার জন্য, আমাদের প্রথমে আলিঙ্গন মুখের অফিসিয়াল ওয়েবসাইটে নিজেদের নিবন্ধন করে শুরু করতে হবে। আপনার শংসাপত্র সহ এই ওয়েবসাইটে সাইন আপ করে আলিঙ্গন মুখের এই সম্প্রদায়ে যোগ দিন।

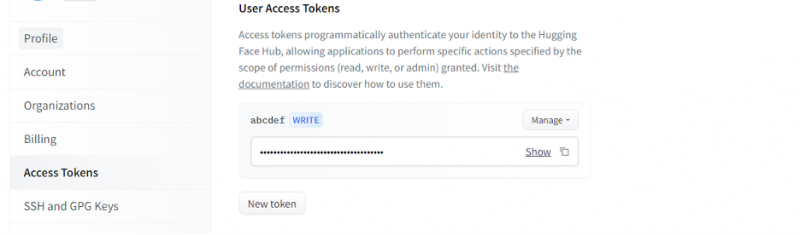

একবার আমরা Hugging Face-এ একটি অ্যাকাউন্ট পেয়ে গেলে, আমাদের এখন অনুমান API-এর অনুরোধ করতে হবে। API অনুরোধ করতে, অ্যাকাউন্ট সেটিংসে যান এবং 'অ্যাক্সেস টোকেন' নির্বাচন করুন৷ একটি নতুন উইন্ডো ওপেন হবে। 'নতুন টোকেন' বিকল্পটি নির্বাচন করুন এবং তারপর প্রথমে টোকেনের নাম এবং 'WRITE' হিসাবে এর ভূমিকা প্রদান করে টোকেন তৈরি করুন। একটি নতুন টোকেন তৈরি করা হয়। এখন, আমাদের এই টোকেন সংরক্ষণ করতে হবে। এই বিন্দু পর্যন্ত, আমরা আলিঙ্গন মুখ থেকে আমাদের টোকেন আছে. পরবর্তী উদাহরণে, আমরা দেখব কিভাবে আমরা একটি অনুমান API পেতে এই টোকেন ব্যবহার করতে পারি।

উদাহরণ 1: হাগিং ফেস ইনফারেন্স এপিআই দিয়ে কীভাবে প্রোটোটাইপ করবেন

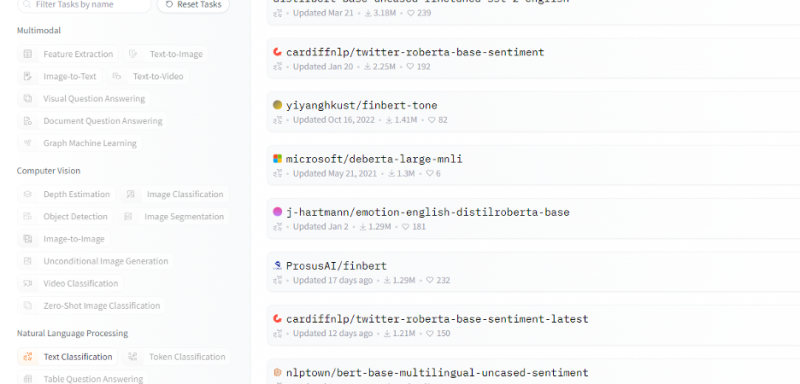

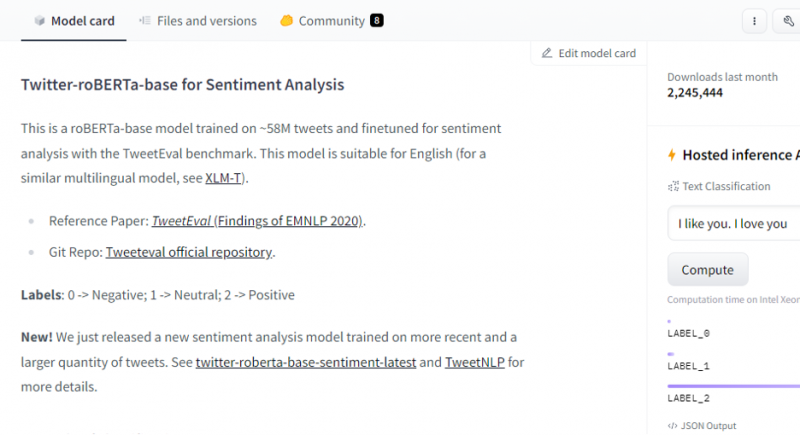

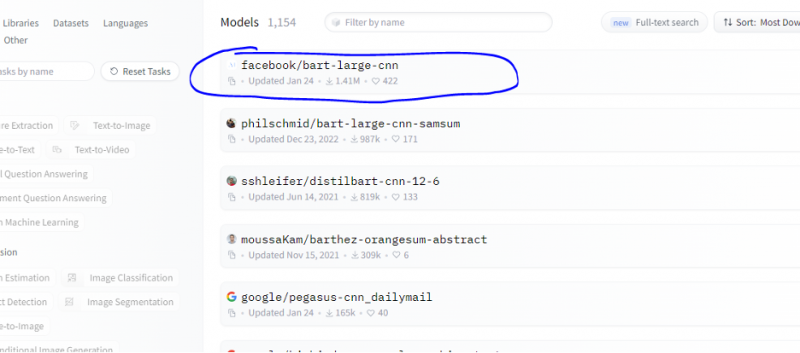

এখন পর্যন্ত, আমরা কিভাবে Hugging Face দিয়ে শুরু করতে হয় তার পদ্ধতি নিয়ে আলোচনা করেছি এবং আমরা Hugging Face থেকে একটি টোকেন শুরু করেছি। এই উদাহরণটি দেখায় কিভাবে আমরা একটি নির্দিষ্ট মডেলের (মেশিন লার্নিং) জন্য একটি অনুমান API পেতে এবং এর মাধ্যমে ভবিষ্যদ্বাণী করতে এই নতুন জেনারেট করা টোকেনটি ব্যবহার করতে পারি। আলিঙ্গন মুখের হোমপেজ থেকে আপনি কাজ করতে চান এমন যেকোনো মডেল নির্বাচন করুন যা আপনার সমস্যার সাথে প্রাসঙ্গিক। ধরা যাক আমরা এই মডেলগুলির তালিকার নিম্নলিখিত স্নিপেটে দেখানো টেক্সট শ্রেণীবিভাগ বা অনুভূতি বিশ্লেষণ মডেলের সাথে কাজ করতে চাই:

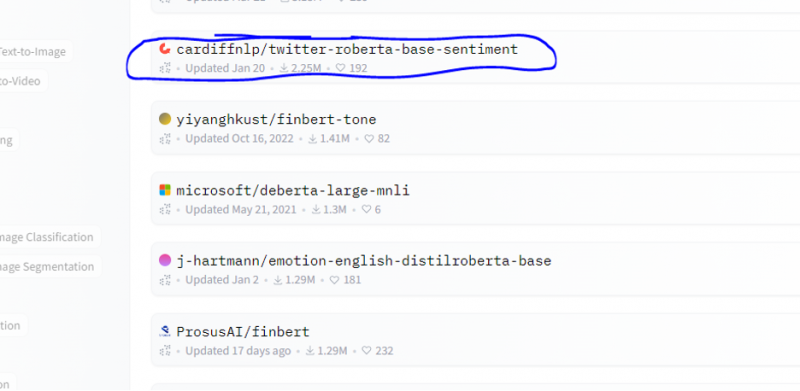

আমরা এই মডেল থেকে অনুভূতি বিশ্লেষণ মডেল চয়ন.

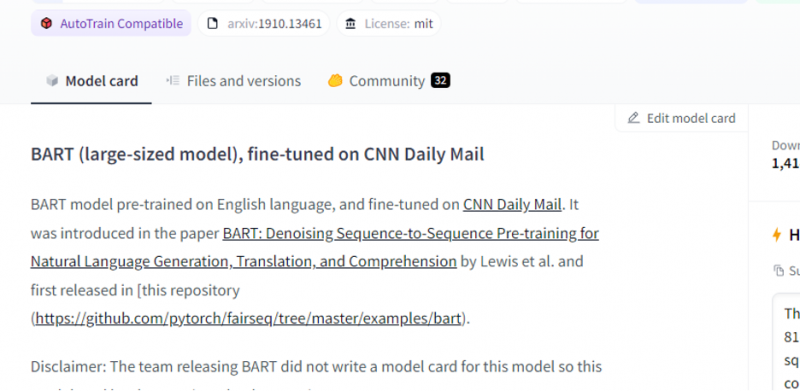

মডেল নির্বাচন করার পরে, এর মডেল কার্ড প্রদর্শিত হবে। এই মডেল কার্ডে মডেলের প্রশিক্ষণের বিশদ এবং মডেলটির কী বৈশিষ্ট্য রয়েছে সে সম্পর্কিত তথ্য রয়েছে। আমাদের মডেল হল roBERta-বেস যা অনুভূতি বিশ্লেষণের জন্য 58M টুইটগুলিতে প্রশিক্ষিত। এই মডেলটির তিনটি প্রধান ক্লাস লেবেল রয়েছে এবং এটি প্রতিটি ইনপুটকে তার প্রাসঙ্গিক ক্লাস লেবেলে শ্রেণীবদ্ধ করে।

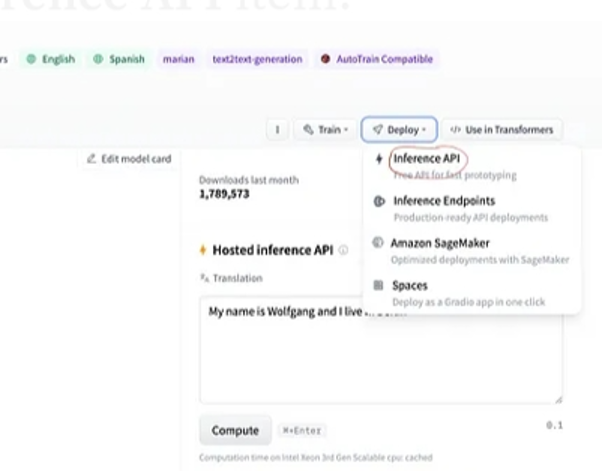

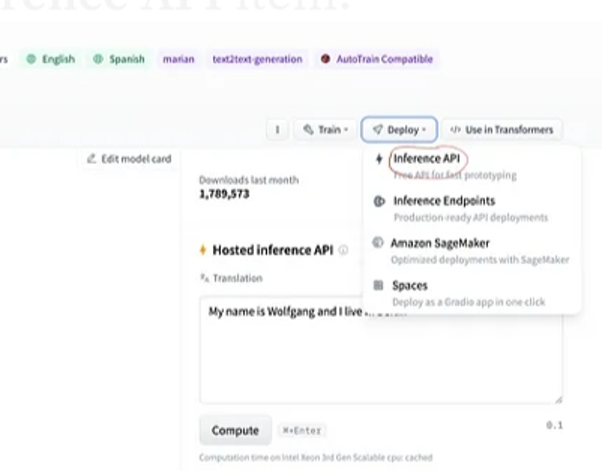

মডেল নির্বাচনের পর, যদি আমরা উইন্ডোর উপরের ডানদিকে থাকা ডিপ্লয়মেন্ট বোতামটি নির্বাচন করি, এটি একটি ড্রপ-ডাউন মেনু খোলে। এই মেনু থেকে, আমাদের 'ইনফারেন্স API' বিকল্পটি নির্বাচন করতে হবে।

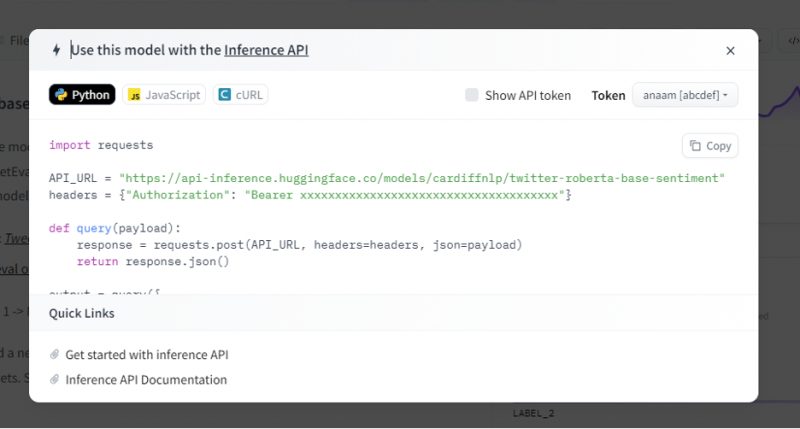

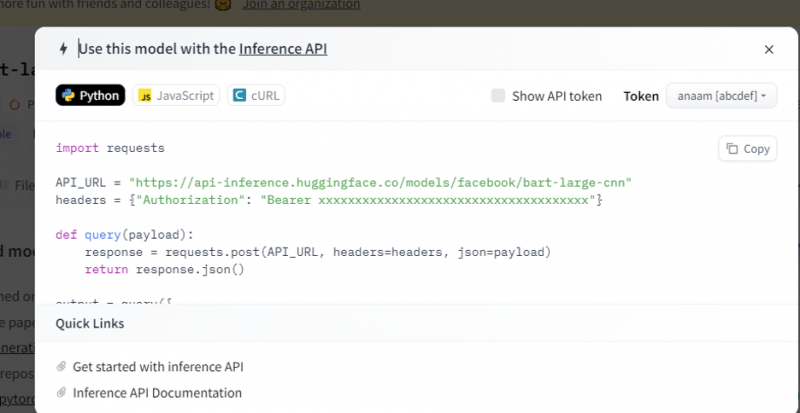

অনুমান API তারপর এই অনুমানের সাথে এই নির্দিষ্ট মডেলটি কীভাবে ব্যবহার করতে হয় তার একটি সম্পূর্ণ ব্যাখ্যা প্রদান করে এবং আমাদের দ্রুত এআই মডেলের জন্য প্রোটোটাইপ তৈরি করতে দেয়। অনুমান API উইন্ডোটি পাইথনের স্ক্রিপ্টে লেখা কোডটি প্রদর্শন করে।

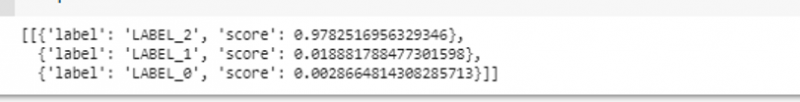

আমরা এই কোডটি কপি করে পাইথন আইডিই-তে এই কোডটি কার্যকর করি। আমরা এর জন্য Google Colab ব্যবহার করি। পাইথন শেলে এই কোডটি কার্যকর করার পরে, এটি একটি আউটপুট প্রদান করে যা স্কোর এবং লেবেল পূর্বাভাস সহ আসে। এই লেবেল এবং স্কোর আমাদের ইনপুট অনুযায়ী দেওয়া হয়েছে যেহেতু আমরা 'টেক্সট-সেন্টিমেন্ট বিশ্লেষণ' মডেল বেছে নিয়েছি। তারপরে, আমরা মডেলকে যে ইনপুট দিই তা হল একটি ইতিবাচক বাক্য এবং মডেলটিকে তিনটি লেবেল ক্লাসে প্রাক-প্রশিক্ষিত করা হয়েছে: লেবেল 0 বোঝায় নেতিবাচক, লেবেল1 বোঝায় নিরপেক্ষ, এবং লেবেল 2 ইতিবাচক হিসাবে সেট করা হয়েছে। যেহেতু আমাদের ইনপুট একটি ইতিবাচক বাক্য, তাই মডেল থেকে স্কোর পূর্বাভাসটি অন্য দুটি লেবেলের চেয়ে বেশি যার মানে মডেলটি বাক্যটিকে 'ইতিবাচক একটি' হিসাবে ভবিষ্যদ্বাণী করেছে৷

আমদানি অনুরোধAPI_URL = 'https://api-inference.huggingface.co/models/cardiffnlp/twitter-roberta-base-sentiment'

হেডার = { 'অনুমোদন' : 'বাহক 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' }

ডিফ প্রশ্ন ( পেলোড ) :

প্রতিক্রিয়া = অনুরোধ. পোস্ট ( API_URL , হেডার = হেডার , json = পেলোড )

ফিরে প্রতিক্রিয়া json ( )

আউটপুট = প্রশ্ন ( {

'ইনপুট' : 'তুমি আমার সাথে থাকলে আমার ভালো লাগে' ,

} )

আউটপুট:

উদাহরণ 2: অনুমানের মাধ্যমে সংক্ষিপ্তকরণ মডেল

আমরা একই পদক্ষেপগুলি অনুসরণ করি যা পূর্ববর্তী উদাহরণে দেখানো হয়েছে এবং সারাংশ মডেল বাসটিকে আলিঙ্গন মুখ থেকে অনুমান API ব্যবহার করে প্রোটোটাইপ করি। সংক্ষিপ্তকরণ মডেল হল একটি প্রাক-প্রশিক্ষিত মডেল যা সম্পূর্ণ পাঠ্যটির সংক্ষিপ্তসার করে যা আমরা এটিকে ইনপুট হিসাবে দিই। Hugging Face অ্যাকাউন্টে যান, উপরের মেনু বার থেকে মডেলটিতে ক্লিক করুন, এবং তারপর সারসংক্ষেপের সাথে প্রাসঙ্গিক মডেলটি নির্বাচন করুন, এটি নির্বাচন করুন এবং এর মডেল কার্ডটি সাবধানে পড়ুন।

আমরা যে মডেলটি বেছে নিয়েছি সেটি হল একটি প্রাক-প্রশিক্ষিত BART মডেল এবং এটি ডেটাসেট সিএনএন ডেইল মেলের সাথে সূক্ষ্মভাবে সুর করা হয়েছে। BART হল এমন একটি মডেল যা BERT মডেলের মত যার একটি এনকোডার এবং ডিকোডার রয়েছে। এই মডেলটি কার্যকরী হয় যখন এটি বোঝা, সংক্ষিপ্তকরণ, অনুবাদ এবং পাঠ্য-প্রজন্মের কাজগুলির জন্য সূক্ষ্ম টিউন করা হয়।

তারপরে, উপরের ডানদিকের কোণ থেকে 'ডিপ্লয়মেন্ট' বোতামটি নির্বাচন করুন এবং ড্রপ-ডাউন মেনু থেকে অনুমান API নির্বাচন করুন৷ অনুমান API অন্য একটি উইন্ডো খোলে যেটিতে কোড এবং এই অনুমানের সাথে এই মডেলটি ব্যবহার করার নির্দেশাবলী রয়েছে।

এই কোডটি অনুলিপি করুন এবং এটি একটি পাইথন শেলে কার্যকর করুন।

মডেলটি আউটপুট ফেরত দেয় যা আমরা এটিতে যে ইনপুট দিয়েছিলাম তার সারাংশ।

উপসংহার

আমরা Hugging Face Inference API এ কাজ করেছি এবং শিখেছি কিভাবে আমরা প্রাক-প্রশিক্ষিত ভাষার মডেলগুলির সাথে কাজ করতে এই অ্যাপ্লিকেশনটির প্রোগ্রামেবল ইন্টারফেস ব্যবহার করতে পারি। আমরা নিবন্ধে যে দুটি উদাহরণ করেছি তা মূলত NLP মডেলের উপর ভিত্তি করে। আলিঙ্গন ফেস API বিস্ময়কর কাজ করতে পারে যদি আমরা আমাদের অ্যাপ্লিকেশনগুলিতে AI মডেলগুলির দ্রুত সংহতকরণ প্রদান করে একটি দ্রুত প্রোটোটাইপ বিকাশ করতে চাই। সংক্ষেপে, হাগিং ফেস আপনার সমস্ত সমস্যার সমাধান আছে রিইনফোর্সমেন্ট লার্নিং থেকে কম্পিউটার ভিশন পর্যন্ত।